¡WOW!

Aquí podrás encontrar interesantes artículos científicos

que probablemente desconocías.

¡Echa un vistazo!

El álgebra

mejora el tratamiento para el cáncer de próstata.

A través

de la predicción del movimiento de los órganos comprometidos en la radioterapia

(vesículas seminales, próstata, recto y vejiga), el modelo matemático ayuda a

precisar las dosis del tratamiento, así como a evitar efectos secundarios.

Una de

las formas más comunes de tratamiento del cáncer de próstata, cuando éste no ha

hecho metástasis, es la radioterapia, que consiste en tomar una foto de los

órganos comprometidos, que se delinean y así se propone la dosis por utilizar.

Sin embargo, dicha fotografía no es fiel a la distribución de los órganos ya

que estos se mueven.De acuerdo con la posición que ésta ocupe en el cuerpo, y

teniendo en cuenta que solo tiene ciertas direcciones sobre las cuales se

deforma, lo que se hace es identificarlas y predecir su movimiento.

Basado en

ese modelo, señala, se pudieron cuantificar las incertidumbres que genera el

movimiento de la vejiga durante el tratamiento, lo cual afecta la dosis que se

puede irradiar.

Para

llegar al resultado, la metodología utilizada por el investigador incorporó una

técnica de álgebra lineal que permite la descomposición de una matriz en tres

componente, conocida como "machine learning".

El

ingeniero Richard Ríos, mezcló variantes e información como: dosis, órganos,

movimiento y toxicidad, que incluyó en un modelo matemático con el que

consiguió reducir la incertidumbre en cuanto al movimiento de los órganos

involucrados en el cáncer de próstata.

El joven

investigador menciona que una de las razones por las cuales los órganos se

mueven es porque los pacientes consumen agua, lo que hace que tanto la vejiga

como el recto se llenen y empujen unos órganos contra otros.

Esta

situación hace que la dosis que inicialmente se planea para la radioterapia no

sea eficaz, pues cuando ésta se realiza se irradian tanto las células afectadas

como las sanas; por el contrario, aumentan las probabilidades de que el

paciente desarrolle efectos secundarios o que se pierda el control sobre el

tumor.

FUENTE:

http://noticiasdelaciencia.com/not/17452/el-algebra-mejora-el-tratamiento-de-cancer-de-prostata/

El uso de las matemáticas por Miguel Ángel cuando pinto

"La creación de Adán".

Se cree

que la Proporción Áurea, también conocida como la Proporción Divina, el Número

Áureo y con otros nombres similares, es una proporción geométrica que, por

alguna razón que nunca nadie ha podido explicar de forma satisfactoria, sería

la más agradable estéticamente para la percepción visual humana. Se dice que se

empleó para guiar la construcción de las pirámides egipcias, la del Partenón en

Atenas, y que bastantes pintores, consciente o inconscientemente, la usaron en

cuadros, incluyendo algunos tan carismáticos como la Gioconda de Leonardo da

Vinci.

A la

Proporción Áurea, con un valor matemático de aproximadamente 1,618, también se

la ha considerado como una especie de “constante” natural, presente en

infinidad de estructuras biológicas, desde la curvatura de los colmillos de los

elefantes, hasta la forma espiral de las conchas de algunos moluscos.

Miguel

Ángel fue no solo pintor y escultor, sino también un experto en anatomía

humana. Diseccionó numerosos cadáveres y gracias a ello y a otras observaciones

desarrolló un profundo conocimiento de la anatomía humana, algo que le sirvió

para reproducir de manera muy realista cuerpos humanos en su arte. Entre sus

trabajos artísticos mejor conocidos están los frescos pintados en el techo de

la Capilla Sixtina, en Roma.

El equipo

de la Universidad Federal de Ciencias de la Salud de Porto Alegre en Brasil, ha

realizado un análisis digital de “La Creación de Adán”, obteniendo evidencias

matemáticas de que Miguel Ángel pintó ese fresco usando la Proporción Divina.

A juzgar

por lo descubierto en el análisis, hay que suponer que la belleza y armonía

reconocidas en todos los trabajos de Miguel Ángel podrían estar basadas no solo

en su conocimiento de las proporciones anatómicas humanas. Él probablemente sabía

que las estructuras anatómicas que incorporan la Proporción Áurea ofrecen una

serie de cualidades positivas y, por tanto, la utilizó para aumentar la calidad

estética de sus trabajos.

FUENTE:

http://noticiasdelaciencia.com/not/15308/el-uso-de-las-matematicas-por-miguel-angel-cuando-pinto-la-creacion-de-adan/

Trabajan modelos matemáticos para inferir futuras

erupciones en calderas volcánicas

Con el

objetivo de entender su impacto en la decadencia de la civilización maya, pero

al mismo tiempo generar un modelo matemático que permita visualizar el alcance

de próximos siniestros, el doctor Gerardo de Jesús Aguirre Díaz, investigador

de la Universidad Nacional Autónoma de México (UNAM), realiza estudios en la

caldera volcánica de Ilopango en El Salvador.

Se trata

de un proyecto financiado por el Consejo Nacional de Ciencia y Tecnología

(Conacyt) que tiene una duración de tres años a partir de marzo de 2015 y del

que ya se desprenden algunos hallazgos importantes. "Se sabe que la última

erupción que tuvo esta caldera fue catastrófica, sucedió hace aproximadamente

mil 500 años —muy reciente en términos geológicos— y pudo haber sido el factor

detonante para que la civilización maya se disgregara", explicó Aguirre

Díaz.

En

entrevista con la Agencia Informativa Conacyt, dijo que ese es uno de los

motivos principales por los cuales el trabajo es de interés para México, aun

cuando el estudio en sí no tenga lugar dentro del territorio nacional; sin

embargo, los efectos de la erupción en Ilopango tuvieron consecuencias en el

sureste de México y podría volver a tenerlas en un futuro.

¿Cuál es

el principal objetivo de la investigación?

Apoyado

por estudiantes de doctorado y un grupo de diez personas (investigadores de

diferentes especialidades en gerardo de jesus aguirre01geociencias,

matemáticas, antropología y arqueología), se realiza la investigación en torno

a la erupción catastrófica —o supererupción— de la caldera de Ilopango, y se

busca definir su relación con el declive de la civilización maya, pero también

generar un modelo matemático que permita inferir el escenario de posibles

próximas erupciones y los alcances de esta estructura volcánica.

¿En qué

consiste el trabajo que están realizando?

Se trata

de mucho trabajo de campo, hay que visitar la caldera y sus alrededores para

realizar trabajo geológico, es decir, revisar y estudiar los productos

volcánicos que salieron de la caldera, ordenarlos de manera

"espacio-temporal", en términos sencillos, ubicar y estudiar los

residuos de las erupciones que ha tenido esta caldera.

Entonces,

básicamente lo que hacemos es ir a medir en el campo los depósitos y tomar

muestras para diferentes tipos de análisis en el laboratorio. Los ubicamos en

primera instancia, medimos el volumen que representa cada uno de ellos,

determinamos hasta dónde llegaron esas erupciones y una vez que se organizan en

el tiempo y espacio los residuos de la caldera, comenzamos el trabajo

geocronológico.

¿En qué consiste el

trabajo geocronológico?

Sacamos

las edades absolutas a través de técnicas muy especializadas de geoquímica de

isótopos, para este caso las técnicas analíticas de carbono 14, de argón-argón,

que es el argón 39 y 40, y también las de uranio-plomo y uranio-torio en

circones.

Lo que

hacemos es obtener las edades de los productos arrojados por la caldera y ver

si hay algún tipo de recurrencia en el tiempo en las diferentes erupciones

mayores que ha tenido. También utilizaremos dicho conocimiento para estudiar a

detalle la última erupción, que probablemente causó la disgregación maya.

¿En qué consisten las pruebas de geoquímica de isótopos?

Para

definir la edad de las rocas recurrimos a los isótopos de algunos elementos que

contienen estas. Las rocas presentan minerales, sobre todo las frase gerardo de

jesus aguirre01volcánicas, en cuyo caso además de los minerales se tiene

también vidrio volcánico; dentro de los componentes químicos del vidrio y de

los minerales existen algunos elementos radioactivos que aprovechamos para

saber la edad de la roca.

Muchos de

los elementos que hay en la naturaleza tienen algo de radioactividad y

aprovechamos esa característica para utilizar los distintos sistemas ya

mencionados, como el de argón 40 y 39 (gas noble que se produce por el

decaimiento radioactivo del potasio) o el de uranio-plomo, en donde el uranio,

que es el material radioactivo, decae hacia el plomo.

En el

momento que la roca se cristalizó al salir de la erupción, comienza a trabajar

el relojito isotópico y nosotros con instrumentos muy sofisticados

(espectrómetros de masa muy sensibles) podemos determinar cuánto tiempo ha

pasado, midiendo la cantidad de un isótopo contra el otro.

¿Cómo pudo impactar la última erupción en el declive de la

civilización maya?

Este es

un proyecto multidisciplinario, donde tambien interviene un grupo de

arqueólogos, quienes harán excavaciones para recolectar información en sitios

arqueológicos que se sabe fueron cubiertos por la ceniza volcánica de esta

erupción.

Y fue

esta erupción, de hace aproximadamente mil 500 años, de la caldera de Ilopango

—la cual muy probablemente también afectó el clima a escala global—, la que

aparentemente provocó la disgregación de la cultura maya, misma que con el paso

del tiempo se tradujo en el declive de esta civilización.

¿Por qué

es importante conocer las recurrencias en el tiempo de las erupciones?

Esta

caldera no solo tuvo esa última erupción, nosotros, gracias al trabajo de

identificación de recurrencia en el tiempo, hemos contabilizado al menos ocho

más, dato que representa el primer hallazgo importante de nuestro trabajo de

investigación.

Incluso

tuvo erupciones mucho más grandes a la registrada hace mil 500 años, así que

intentaremos definir su historia eruptiva completa con un enfoque que vaya más

allá de su impacto a la civilización maya, con la intención de definir si la

caldera representa un peligro en el futuro porque aún se encuentra activa.

En

resumen, el segundo enfoque de la investigación tiene que ver con la

peligrosidad volcánica. Intentaremos, básicamente, deducir si existe el riesgo

de una nueva erupción de grandes dimensiones y, para lograrlo, debemos conocer

toda la historia volcánica de la caldera, desde que surge hasta su última

actividad.

Haremos

modelos matemáticos que alimentaremos con los datos de campo para hacer

simulaciones numéricas de las erupciones pasadas, sobre todo de la última

supererupción que afectó a los mayas, lo cual permitirá elaborar modelos de

erupciones futuras y saber qué tanto afectarían a El Salvador y cuál sería su

impacto a nivel continental, incluyendo por supuesto México.

(Fuente: CONACYT/DICYT)

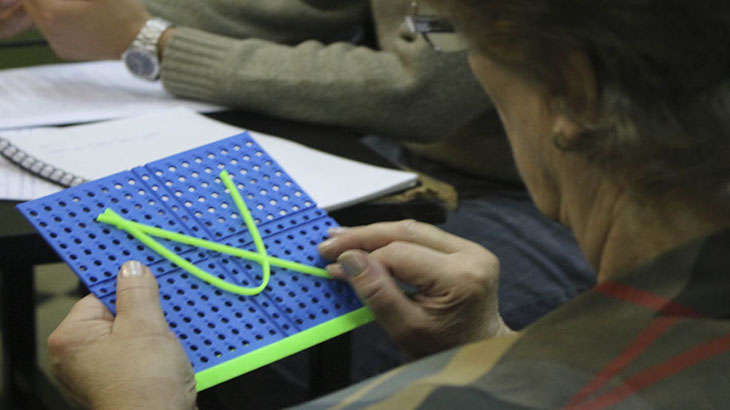

JUDITH, juego de enseñanza

matemática para estudiantes con discapacidad visual

¿Cómo

hace un docente para enseñarle funciones matemáticas a un ciego? ¿Cómo puede

procesar esta información si no puede ver su gráfica?, fueron las preguntas que

se hizo el físico Eduardo Rodríguez, investigador docente del Instituto de

Industria (IDEI) de la Universidad Nacional de General Sarmiento (UNGS), en

Argentina, mientras le enseñaba a su hija funciones matemáticas.

Luego de

investigar qué dispositivos había disponibles para la enseñanza y el

aprendizaje de conceptos matemáticos en estudiantes con discapacidad visual, ya

sean ciegos o disminuidos, nació JUDITH, el Juego Didáctico para Tareas

Hápticas.

“La

Universidad no contaba con recursos apropiados y nos pusimos a pensar cómo

resolver este déficit, sobre todo porque en la UNGS hay ingresantes ciegos que,

sin importar qué carrera quieran estudiar, tienen que cursar un taller de

matemática en el Curso de Aprestamiento Universitario (CAU), que incluye el

tema de funciones matemáticas”, explica Rodríguez en entrevista con Argentina

Investiga.

De bajo

costo y fabricada íntegramente en el Laboratorio de Ingeniería con una

impresora 3D, JUDITH tiene tres partes: un tablero rectangular, con lados de 16

cm y 17 cm, que representa un sistema cartesiano; un soporte para el tablero,

que incluye una regla con marcas cada un centímetro y un transportador con

marcas cada 10 grados para que el estudiante pueda medir longitudes y ángulos;

y las funciones, que en el tablero quedan en relieve. El dispositivo está

acompañado por un manual destinado a los docentes.

Este

dispositivo, desarrollado por el Área de Ciencias y Tecnologías Básicas, fue

testado recientemente; la primera en usarlo fue Judit Martínez, estudiante del

profesorado universitario en Historia. Martínez es una de las diez estudiantes

con discapacidad visual que cursa en la actualidad el CAU, que permite el

ingreso a la Universidad.

“La

primera vez que la estudiante usó el tablero resultó una experiencia de mucho

impacto. Su expresión cambiaba mientras recorría con los dedos la función que

llamamos ‘parábola’ y que ella empezaba a descubrir. Fue una experiencia

fructuosa, también por la compresión de conceptos al desarrollar las consignas,

tales como decir cuántas raíces (cuantos ceros) tenía la función y encontrar

sus extremos y zonas de crecimiento y decrecimiento”, describe Maximiliano

Véliz, ingeniero electromecánico egresado de la UNGS e investigador docente del

IDEI.

“Es

cómodo, práctico y útil”, resumió Judit Martínez, que desde este momento quedó

ligada al dispositivo, no sólo por ser la primera en utilizarlo, sino porque

lleva su nombre. La estudiante cuenta que, hasta el momento, a la hora de

aprender matemática usaba unos gráficos de papel con relieve. “Muchas veces las

líneas de los planos se borran, este dispositivo no se rompe”, dice, y

recomienda su uso a otros estudiantes.

“Es un

dispositivo que tiene mucha capacidad de expansión para nuevos usos. Los docentes

pueden solicitar cualquier tipo de función matemática para la construcción. Lo

único que debe suministrar es la ecuación analítica que quiere que la

materialicemos para el tablero”, destaca Véliz.

JUDITH

también puede ser utilizado en la enseñanza en estudiantes videntes, porque

aporta otra forma de visualización de las gráficas de las funciones. “Con el

dispositivo -expresa Rodríguez-, un alumno vidente no sólo ve las funciones

sino que ‘también las toca’. Esta estrategia es innovadora y puede servir para

mejorar la percepción del concepto de función y de sus atributos”.

Ahora, el

equipo trabaja en los detalles de JAIME, el Juego de Áreas Impresas para

Matemática Elemental. “En el taller de matemática del CAU hay ejercicios para

calcular el área de figuras complejas compuestas por otras simples, como

cuadrados, rectángulos, triángulos, círculos o fracciones de éstos. Por

ejemplo, un yin yang se puede ver como la unión de círculos completos y

fracciones de círculos de otro tamaño. A los estudiantes, en muchos casos, les

cuesta darse cuenta de cómo esa integración de figuras compone otra figura más

compleja. También está pensado para que ayude a la visualización de los

problemas que se puedan plantear en torno al cálculo de áreas”, explica

Rodríguez, director del proyecto.

Ambos

dispositivos de estudio ya fueron presentados en sociedad, en el marco de una

reunión de la Comisión en Discapacidad de la Universidad, y se encuentran a

disposición de estudiantes y docentes del Curso de Aprestamiento Universitario

de la UNGS. (Fuente: Argentina Investiga)

Matemáticas para proteger las obras de arte de la luz natural

Los rayos

del sol son fuente de inspiración para muchos artistas, aunque también se

pueden convertir en su peor enemigo, al dañar las obras cuando están expuestas.

“En las pinturas al óleo existe un efecto fotoquímico producido por la luz

visible y ultravioleta que provoca cambios en las estructuras moleculares de

las obras, modificando el color y acelerando su envejecimiento”, explica

Santiago Mayorga Pinilla, investigador de la facultad de Óptica y Optometría de

la Universidad Complutense de Madrid (UCM), en España.

A esto

hay que sumar la exposición al infrarrojo –en la que el Sol emite una cantidad

de radiación muy elevada– la cual, además de producir una alteración

fotoquímica, modifica la temperatura, lo que facilita la ruptura de enlaces

químicos. Esto provoca un aumento del efecto fotoquímico producido por la

radiación visible.

“Si estos

valores están por encima de 25 ºC se consideran perjudiciales, a lo que hay que

sumar que los cambios de temperatura bruscos generan agrietamientos en las

pinturas al óleo, por las tensiones mecánicas”, añade el físico.

Para

abordar este problema, los científicos de la UCM, en colaboración con la

Universidad Politécnica de Madrid, el Museo del Prado y el Instituto de Cultura

de España, han desarrollado un modelo de cálculo muy preciso que tiene en

cuenta todos los factores que intervienen en el proceso analizando, tanto la

cantidad de radiación en el tiempo y en el espacio, como su distribución

espectral.

El

método, que se publica en la revista Renewable Energy, ha sido probado en el

claustro del Monasterio de Santa María de El Paular (Madrid), donde se exponen

54 cuadros de Vicente Carducho. El cálculo ideado por los científicos tiene en

cuenta la posición del Sol, cada tipo de día desde el punto de vista

meteorológico y cómo se comporta esta radiación en el claustro, en concreto, en

las zonas donde están colocadas las pinturas.

“El

método permite conocer en todo momento la cantidad de radiación de forma

espectral a la que están sometidas las obras de arte, y proponer actuaciones

como modificar la ubicación de los cuadros, poner más protección en las

ventanas o utilizar en ciertas zonas iluminación artificial”, enumera Mayorga.

Aunque es

imposible evitar el envejecimiento de las obras de arte que se exponen a la

luz, con el nuevo sistema los científicos intentan controlar estos efectos

dañinos y minimizarlos, retrasando su deterioro. Para ello han utilizado

softwares matemáticos, de diseño CAD y de iluminación, además de aparatos de

medida de iluminación y de espectros específicos.

“Este

trabajo es exportable a cualquier exposición que se ilumine con luz natural,

teniendo en cuenta las características del material utilizado”, afirma el

físico. (Fuente: Universidad Complutense de Madrid)

Matemáticas para mejorar

la caducidad en las transfusiones

La sangre

nunca se transfunde directamente al paciente. De la sangre extraída básicamente

se obtienen tres productos: glóbulos rojos, plasma y plaquetas. Estos productos

tienen una vida limitada, y su caducidad es diferente: el plasma se puede

conservar hasta dos años, los glóbulos rojos 28 días, y las plaquetas caducan a

los cinco días. La gestión de concentrados de plaquetas es complicada debido a

su pronta caducidad y a que la demanda diaria es incierta y no admite demora.

Esto hace que el responsable de su producción tenga que tomar decisiones

difíciles y a veces arriesgadas: una baja producción conlleva el riesgo de

pacientes desatendidos; por lo que la tendencia natural es generar una sobreproducción,

lo cual trae consigo unas altas tasas de caducidad y un aumento de los costes

económicos, ya que se trata de productos costosos.

El Centro

Vasco de Transfusión y Tejidos Humanos (CVTTH) acudió al grupo Transferencia de

Tecnología Matemática de la UPV/EHU, en España, para desarrollar una

herramienta matemática para la optimización de la gestión de existencias de los

concentrados de plaquetas (CP). El modelo ha sido construido a partir de los

datos históricos de 2012, y ha sido validado con datos históricos de 2013:

realizando una simulación que da como resultado cuál hubiera sido la producción

y la caducidad siguiendo las directrices del modelo, y comparando estos

resultados con la demanda real ocurrida en 2013.

La

comparativa entre los resultados del modelo y lo sucedido durante 2013 muestra

que con una reducción anual del 14,42 % de los CP producidos (1.472 CP menos)

se hubiera logrado cubrir toda la demanda, sin necesidad de realizar

importaciones de CP. Esto hubiera supuesto una reducción muy significativa del

90,18 % de los CP caducados respecto a la cifra real (1.460 CP menos). De forma

colateral, se hubiera logrado una mejora de casi un día en la edad media de los

CP transfundidos, ya que se obtendría una reducción del 65,07 % de los CP

transfundidos con cinco días de edad, lo cual es muy importante desde el punto

de vista clínico. Esto indudablemente tiene unas repercusiones económicas

importantes: aplicando las tarifas establecidas en el País Vasco en 2013, el

ahorro potencial por reducción de la producción oscilaría entre 420.000 € y

690.000 €.

La

caducidad de los CP es un problema global que debe tratarse conjuntamente en

toda la cadena transfusional. La red transfusional del País Vasco está

constituida por un único centro productor, el CVTTH, doce hospitales públicos y

nueve clínicas privadas, si bien sólo existen stocks fijos de CP en cinco

hospitales públicos. El sistema de información abarca a todas las

organizaciones excepto cinco clínicas privadas, e incluye todos los procesos de

la cadena, desde la donación hasta la transfusión. Esto supone una gestión

directa y centralizada del 100 % de las donaciones y del 94 % de las

transfusiones que se realizan en el País Vasco. El CVTTH produce y suministra

anualmente en torno a 100.000 concentrados de glóbulos rojos, 12.000 plasmas

para transfusión y 10.300 CP.

El modelo

diseñado para la gestión de CP del País Vasco supone un único stock en el

CVTTH, sin tener en cuenta los de los hospitales. El modelo considera que sólo

hay producción los días laborables, aunque se transfunde todos los días del

año. Los CP producidos en lunes, martes, miércoles y jueves entran en stock el

día siguiente por la mañana con un día de edad, mientras que los del viernes

entran en el stock el lunes siguiente con tres días de edad, reproduciendo así

la dinámica real. Al final del día, una vez realizadas todas las transfusiones,

se desechan los CP caducados. El stock se actualiza diariamente por la mañana,

una vez descontadas las caducidades e incorporada la última producción.

El

problema planteado no es sencillo debido a que la demanda no es estacionaria

(depende del día de la semana). Además, hay que tener en cuenta el efecto de la

Semana Santa, navidades y fiestas veraniegas. En el modelo matemático diseñado,

la regla que define el tope diario a producir se fija utilizando un análisis

estadístico de la demanda, y las futuras unidades que caducarán se estiman

mediante un análisis probabilístico.

"Se

puede afirmar que este estudio es útil para conocer mejor la dinámica de

producción, distribución y transfusión de los CP en el País Vasco, y que a

pesar de sus limitaciones, permite establecer pautas —concluye Mikel Lezaun,

investigador principal del grupo—. De hecho, ya se han introducido cambios en

la sistemática de producción de CP: fundamentalmente, una reducción de la

producción ajustándola al día de la semana. Ahora es necesario realizar un seguimiento

de los cambios introducidos para valorar su efectividad. En un futuro próximo

se profundizará en la línea iniciada, realizando estudios más exhaustivos y

complejos que reflejen mejor la realidad". (Fuente: UPV/EHU)

Policías

guiándose por un modelo matemático que predice con acierto dónde se van a

producir más crímenes

Impedir

que se cometa un crimen es un éxito policial mejor que el de atrapar a los

culpables de crímenes ya cometidos. En la película de ciencia-ficción “Minority

Report” (2002), dirigida por Steven Spielberg y protagonizada por Tom Cruise,

se presenta este enfoque llevado a sus últimas consecuencias. La policía ya

casi solo actúa de forma preventiva; capta que alguien se dispone a cometer un

crimen y actúa para impedirlo. Aunque esta situación, y la manera en que esos

policías obtienen la información, están fuera de la realidad, sí parece posible

predecir tendencias generales en la criminalidad, como ha demostrado una

experiencia policial piloto realizada en Los Ángeles, Estados Unidos, mediante

un modelo matemático.

La

respuesta a la pregunta de si las matemáticas pueden combatir la delincuencia

parece por tanto que es afirmativa.

El modelo

matemático diseñado por el equipo de Jeffrey Brantingham, de la Universidad de

California en Los Ángeles (UCLA), para aconsejar dónde debería desplegar más

agentes el Departamento de Policía de Los Ángeles, llevó a una tasa de crímenes

sustancialmente menor durante el período reciente de 21 meses en el que se ha

evaluado la utilidad del modelo en situaciones reales.

El modelo

no solo predijo el doble de crímenes que los pronosticados por analistas

adiestrados, sino que también previno el doble de tales crímenes.

Desarrollan modelos

matemáticos para predecir el punto óptimo de curación del jamón ibérico

Investigadores

del Instituto de la Grasa (CSIC-Sevilla), en España, han desarrollado modelos

matemáticos para predecir la marcha y el momento óptimo de curación del jamón.

De esta forma, precisan cuándo una pieza debe pasar de una fase a otra del

proceso, por ejemplo del secadero a la maduración en bodega. Hasta el momento,

el método para fijar el cambio de periodo en el proceso de producción se basa

en la percepción de los expertos de cada industria, basada en su experiencia

acumulada.

Los

investigadores han ajustado ecuaciones matemáticas para hacer un seguimiento

preciso del comportamiento de las piezas. De esta forma, con el análisis de

parámetros como el perfil de la grasa y la pérdida de humedad, el método es

capaz de predecir cuándo es necesario pasar el jamón a una nueva fase de su

proceso individual de maduración.

Para

obtener el modelo matemático, los investigadores han monitorizado un grupo de

10 jamones durante todo el proceso de curación: desde el sacrificio del cerdo,

hasta que la pieza es viable, durante un periodo de tres años. “Instalamos en

cada pieza equipos que tomaban medidas de varios parámetros de forma continua,

así que cada hora se obtenían datos. Es la primera vez que se hace un

seguimiento de los mismos jamones durante tanto tiempo y sin degradar el

producto”, explica a la Fundación Descubre el responsable del estudio, Manuel

León, del Instituto de la Grasa.

Tras el

análisis de los datos, los investigadores han estudiado la evolución de la

fracción de lípidos del tejido adiposo subcutáneo del jamón ibérico durante el

proceso de curado en seco. Asimismo, han determinado la generación de los

denominados compuestos volátiles, responsables de los aromas del producto, y

que los expertos han agrupado por familias. En concreto, en el trabajo

‘Evolution of volatile hydrocarbons from subcutaneous fat during ripening of

Iberian dry-cured ham. A tool to differentiate between ripening periods of the

process’ publicado en la revista Food Research International se muestra el

estudio de la fracción de hidrocarburos.

Los

investigadores han comprobado los cambios en las cantidades de estos compuestos

en la grasa subcutánea durante el proceso de maduración. De esta forma, han

determinado que un aumento de la temperatura está relacionado con la generación

y pérdida de los hidrocarburos y que, durante la curación, se redujo su

cantidad.

Los

expertos destacan que la información de sus modelos matemáticos permite

optimizar los procesos de la industria cárnica. “Aportamos un modelo científico

a una labor que antes se basaba en la experiencia humana. Si conocemos todo el

recorrido de la pieza es más fácil localizar dónde se ha producido algún fallo,

lo que beneficia a la trazabilidad y a la seguridad alimentaria”, precisa

Manuel León.

Un matemático español

recibe el Premio Fulkerson por refutar una conjetura

Este 12

de julio, en el transcurso de la ceremonia inaugural del 22º International

Symposium on Mathematical Programming (ISMP 2015) que se está celebrando en

Pittsburgh (Pensilvania, EE UU), se ha hecho pública la concesión del Premio

Fulkerson a Francisco Santos Leal, catedrático de Geometría y Topología en la

Universidad de Cantabria y miembro de la Real Sociedad Matemática Española

(RSME).

Este

premio se concede cada tres años en el marco del ISMP, y se pueden otorgar

hasta a tres científicos a la vez en cada ocasión. El hecho de que, por primera

vez en sus 36 años de existencia, esta vez haya habido un único galardonado,

revela la singular importancia del resultado de Francisco Santos.

El

galardón lo recibe por “la resolución en negativo” de la denominada conjetura

de Hirsch. El matemático estadounidense Warren M. Hirsch conjeturó en una carta

dirigida a George Dantzig en 1957 que un politopo (el análogo en dimensiones

superiores de un poliedro) de dimensión d con n caras no puede tener un

diámetro combinatorio mayor que n-d.

De ser

cierta esta conjutura, habría tenido importantes consecuencias sobre la

complejidad de la resolución de problemas de programación lineal, y en

particular sobre el tiempo necesario para ejecutar un método matemático llamado

‘del símplice’.

Pero en

2010 Santos presentó un contrajemplo para refutar la conjetura. El matemático

español construyó, apoyándose en una generalización del Teorema de los d pasos

de Klee y Walkup, un politopo de dimensión 43 con 86 caras y diámetro mayor que

43 (es decir, n-d, en este caso 86-43, superaba lo establecido). El trabajo se

publicó con el título A counterexample to the Hirsch Conjecture en los Annals

of Mathematics.

Desarrollan una

herramienta digital que corrige y explica ejercicios de matemáticas

InterMatia

es el principal producto de PlataformaXY, una nueva Spin-Off de la Universidad

de Sevilla (US), en España, cuyo objetivo es el desarrollo de herramientas de

apoyo al aprendizaje.

Juan

González-Meneses, investigador del grupo Geometría algebraica, sistemas

diferenciales y singularidades de la US, es el principal responsable de este

novedoso portal web de matemáticas para alumnos de secundaria y bachillerato

cuya principal innovación reside en la generación automática de ejercicios

adaptados a diferentes niveles, así como en la explicación detallada de la

resolución correcta, algo que no existía hasta ahora en este tipo de

plataformas.

“Nos

animamos a crear InterMatia tras comprobar que existía un vacío en este tipo de

páginas de aprendizaje para alumnos de instituto, ya que la mayoría de webs

sobre cuestiones matemáticas para secundaria o bachillerato que existen actualmente

se limitan a colecciones de problemas o vídeos que te explican determinadas

cosas, pero no son interactivas”, explica el investigador.

InterMatia

está dirigida tanto a centros educativos como a particulares y pone a

disposición de los alumnos tecnología punta para que estos puedan practicar los

temas del currículum oficial, teniendo a su disposición una corrección

automática y una explicación de la solución en caso de no haber acertado.

Bitcóin, la moneda que

nació de un algoritmo matemático

Todo lo

que sube, baja, y viceversa. Esto, que podría ser una ley apócrifa de la

economía, es el dibujo que trazan las fluctuaciones de bitcóin (BTC), la

criptomoneda cuya unidad se llegó a vender a más de mil euros a principios de

2014. El día que se escribe este artículo, sin embargo, su precio por unidad es

de 210,42 euros, por lo que parece que se recupera de los escasos 166 con los

que comenzó el año.

Hablar de

ella está de moda, pero la moneda electrónica lleva con nosotros desde 2009,

año en el que Satoshi Nakamoto –probablemente, el seudónimo de un grupo de

informáticos– creó el Protocolo Bitcoin, el algoritmo que sustenta la moneda y

permite las transacciones económicas por internet sin mediadores.

Cuando

dos personas interactúan con bitcoines, el comprador traspasa al vendedor un

archivo encriptado y las claves para desencriptarlo. Este archivo es el

fragmento de moneda que corresponde al valor de la compra –por ejemplo, 0,1 BTC

equivaldría hoy a 21,04 euros–. Las monedas pueden ser guardadas en cualquier

ordenador o monedero bitcóin, que es, en esencia, una dirección electrónica

para recibir y transferir criptomonedas.

“El

bitcóin no es dinero”, aclara a Sinc Pablo Fernández Burgueño, abogado en

ejercicio y experto en aspectos legales de la criptomoneda en España. Para este

experto, comprar con este sistema tiene más en común con un trueque que con una

transacción monetaria. “Es una ‘cosa’, en el sentido jurídico de la palabra.

Cuando un cliente paga en bitcoines no realiza una transmisión de dinero

fiduciario, ni de dinero electrónico, ni de cupones, sino de soluciones únicas

a algoritmos matemáticos que responden al protocolo bitcoin”.

Se pueden

conseguir bitcoines en el mercado de compraventa de la moneda, o mediante un

proceso de ‘minería’. En este caso, el minero es un ordenador que trabaja a

destajo para descifrar bitcoines recién creados. Quien los encuentre, se los

queda. El algoritmo lleva escrito, a modo de profecía, que el día que se llegue

a 21 millones de monedas su producción parará.

El precio

queda marcado por la oferta y la demanda. Podría decirse que las fluctuaciones

de su valor responden al ejemplo más puro de la ley maestra del capitalismo,

porque dependen, en exclusiva, de lo que los usuarios quieran pagar por esta

moneda, sin ningún tipo de regulación. Esto provoca que invertir en bitcoines

no esté, en absoluto, exento de riesgo.

Las

matemáticas que subyacen detrás de esta moneda están pensadas para prevenir

muchos de estos peligros, pero hay otros que no dependen de ellas. Estas

fluctuaciones que colocaron al bitcóin en lo más alto de la montaña rusa lo han

dejado recuperándose de una caída escandalosa. Lo último que contribuyó a

pinchar la burbuja fue el cierre de la plataforma japonesa de intercambio de

bitcoines MtGox, el pasado mes de enero. El dinero perdido por el cierre se

calcula en unos 350 millones de euros.

Momentos

de euforia y depresión se viven en cualquier mercado. El problema añadido es

que esta moneda pertenece a un sistema descentralizado y no está respaldada por

ningún valor, como el oro o el petróleo; ni por el banco nacional de ningún

Estado, como las monedas de curso legal, lo que podría amortiguar su caída.

Pero la

trascendencia del bitcóin va mucho más allá de los mercados. Para Félix Moreno

de la Cova, economista y miembro de la Bitcoin Foundation, es la base de un

nueva concepción de la propiedad intelectual. “Las transacciones económicas

suponen solo la mínima parte de lo que su tecnología permite. El algoritmo da

la solución tecnológica a las distribuidoras de productos digitales”.

¿Cómo se mide científicamente la desigualdad?

Mucho se

habla en estos días de cuestiones sensibles como el acceso a la vivienda, la

salud o la educación, por ejemplo, que son aspectos que determinan la equidad

entre los actores sociales. ¿Pero cómo se miden científicamente esas variables

o cómo trabaja un científico social con los datos relacionados con la

diferencias en los ingresos, que determinan el acceso a todos esos beneficios?

Según explicó Gabriel Brondino, investigador de la Universidad Nacional del

Litoral (UNL), en Argentina, la desigualdad es uno de los temas de discusión

más relevantes en la actualidad si observamos las diferencias que existen entre

los niveles de ingreso entre Occidente y sus vástagos (Europa occidental,

Estados Unidos, Japón, Australia, entre otros) y los países de África,

Latinoamérica y el Caribe, principalmente; o bien si miramos hacia el interior

de un determinado país.

“La

desigualdad del ingreso es un problema de extrema sensibilidad, ya que está

relacionado con problemas de pobreza e indigencia, educación, salud, vivienda

y, en general, con las condiciones de vida de gran parte de la humanidad.

Abordar el problema de la desigualdad económica desde una perspectiva

científica demanda, como la mayoría de los objetos de estudio, un enfoque

teórico y herramientas empíricas para mensurar el fenómeno”, sostuvo Brondino,

integrante del Centro de Investigaciones de la Facultad de Ciencias Jurídicas y

Sociales (FCJS).

En este

sentido, Brondino comentó que con el pasar de los años se han propuesto

diferentes formas para medir la desigualdad. Las más relevantes se basan en la

idea de distribución personal del ingreso, en la cual se observan los ingresos

totales de los individuos sin distinguir las fuentes del ingreso (propiedad, trabajo,

renta). En oposición, la distribución funcional del ingreso se concentra en la

distribución según las diferentes categorías del ingreso, siendo las

principales el trabajo asalariado e ingreso de la propiedad. “Supongamos una

población que se compone de n individuos, cada uno de los cuales recibe un

ingreso yi, donde i representa el individuo en cuestión. Luego, tendremos n

ingresos diferentes (y1, y2,…, yn) y la suma de éstos dará como resultado el

ingreso total de la población. El ingreso medio se obtiene dividiendo el

ingreso total por el tamaño de la población, es decir, n.

Esta

información es suficiente para obtener una serie de indicadores estadísticos

que nos permiten conocer, en un momento del tiempo, la estructura del ingreso

en la sociedad. Por ejemplo, podemos calcular la diferencia que existe entre el

ingreso más alto y el más bajo dividido por el ingreso medio. Cuando todos los

individuos tienen el mismo ingreso, la diferencia es nula. No obstante, el

indicador se agranda a medida que mayor es la diferencia entre el ingreso

máximo y el mínimo”. Según destacó, el principal problema de este indicador es

que ignora la distribución de los ingresos que no pertenecen a los extremos.

Pero

Brondino comentó que el indicador que más se utiliza actualmente es el

coeficiente de Gini, que se puede analizar a través de la curva de Lorenz, un

eje de dos dimensiones que ordena la población en porcentajes según su nivel de

ingreso, de menor a mayor, en el eje horizontal e indica el porcentaje del

ingreso total que dispone cada estrato de la población en el eje vertical.

“Obviamente, el 0 por ciento de la población recibe el 0 por ciento del

ingreso, mientras que el 100 por cien de la población recibe el 100 por cien

del ingreso, por lo que la curva se mueve desde una esquina a otra

diametralmente opuesta. Si todos tienen el mismo ingreso, la curva será una

diagonal, pero en ausencia de igualdad perfecta, los estratos más bajos tendrán

una participación en el ingreso proporcionalmente menor”, sostuvo.

-Andrea Rodríguez Ruíz

No hay comentarios:

Publicar un comentario